Précision et pertinence

Les décisions basées sur les données reposent sur des informations tangibles et factuelles, éliminant ainsi les conjectures et les intuitions souvent sujettes à l’erreur. En utilisant des données précises et actualisées, les entreprises peuvent prendre des décisions plus éclairées et pertinentes, ce qui réduit les risques d’erreurs coûteuses

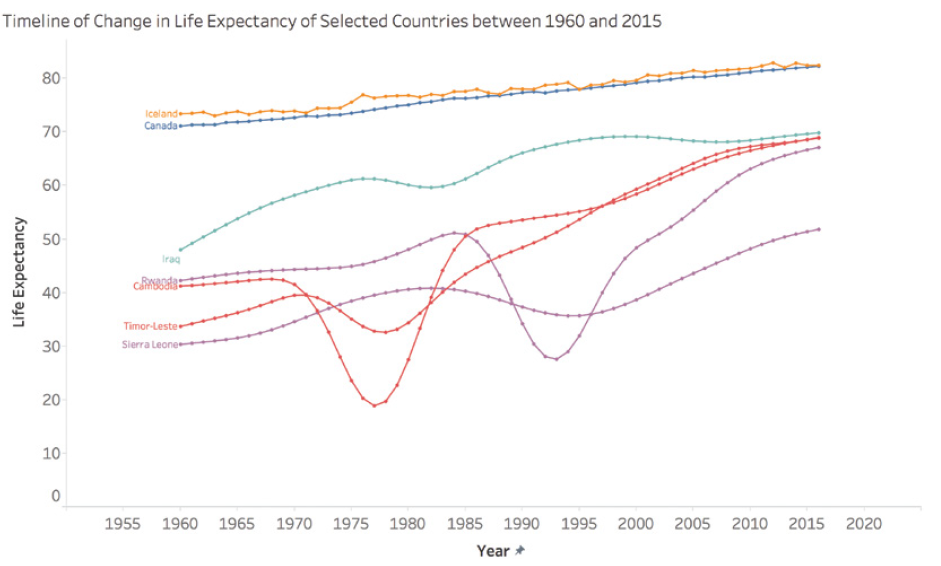

Identification de tendances

En analysant de vastes ensembles de données, les entreprises peuvent repérer des tendances significatives et des schémas récurrents. Cela leur permet d’anticiper les changements du marché, d’identifier de nouvelles opportunités et de rester en avance sur la concurrence.

Personnalisation des expériences client

Les données sur le comportement des clients permettent aux entreprises de créer des expériences personnalisées et sur mesure. En comprenant les préférences et les besoins individuels des clients, les entreprises peuvent offrir des produits et des services mieux adaptés, renforçant ainsi la fidélité et la satisfaction client

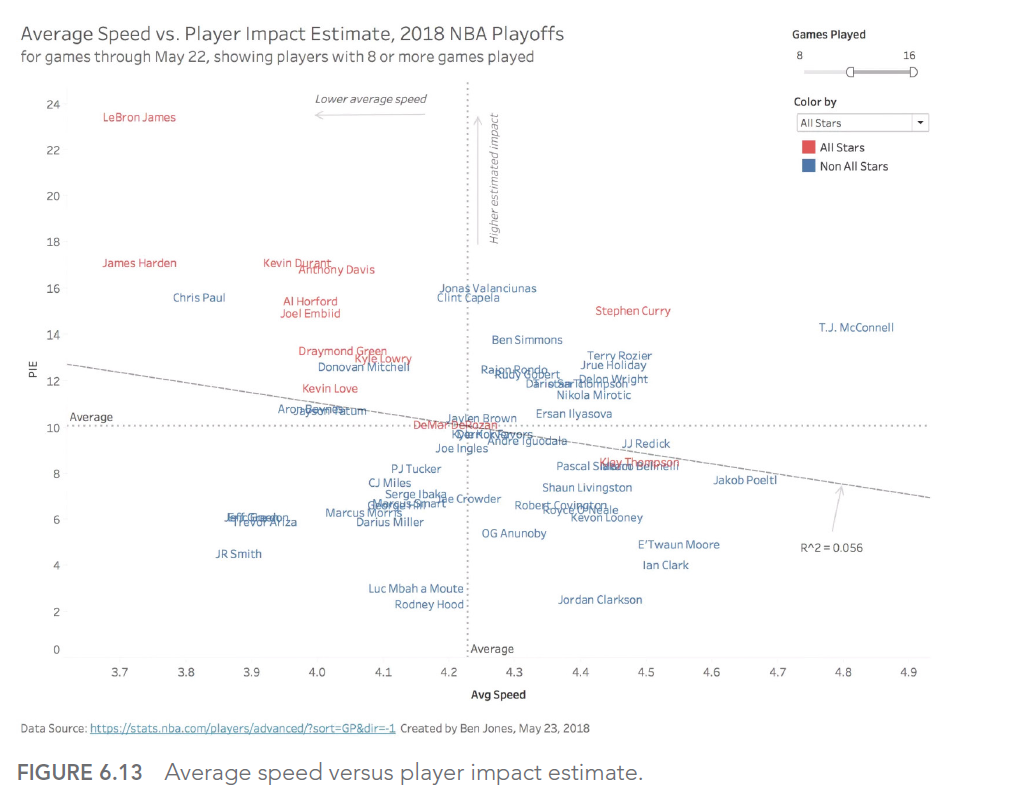

Utilisation de la technologie pour accélérer & optimiser le processus

Les données opérationnelles permettent aux entreprises d’optimiser leurs processus internes. En identifiant les inefficacités et les goulets d’étranglement, les entreprises peuvent apporter des ajustements précis pour améliorer la productivité, réduire les coûts et accroître l’efficacité opérationnelle globale.

Les technologies de traitement des données telles que l’intelligence artificielle (IA), l’apprentissage automatique et l’analyse prédictive peuvent accélérer le processus de prise de décision en automatisant les tâches répétitives et en fournissant des insights exploitables en temps réel. Les algorithmes avancés peuvent détecter des modèles subtils dans les données, aidant ainsi les décideurs à prendre des décisions plus éclairées et plus rapides

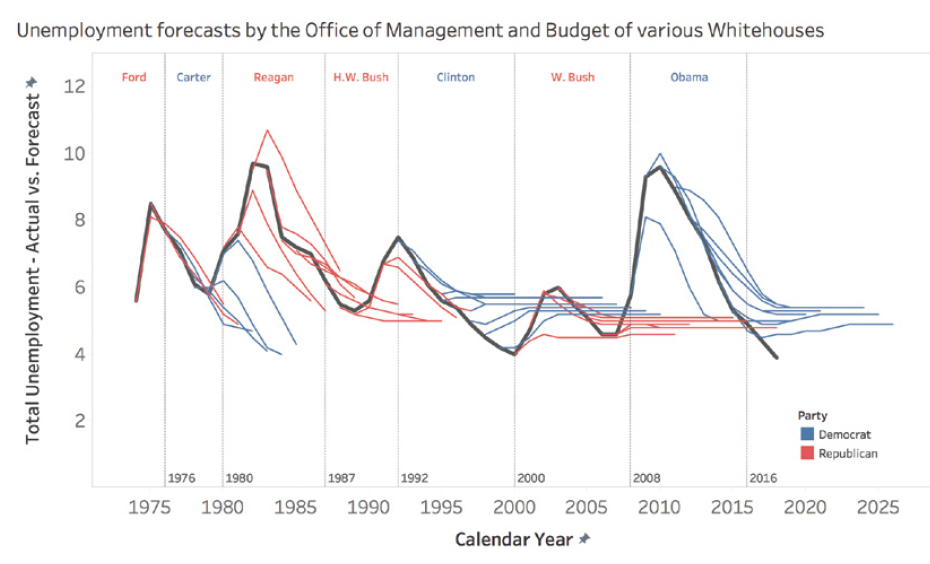

Décisions basées sur les données : la clé de l’agilité & de prise de décision agile

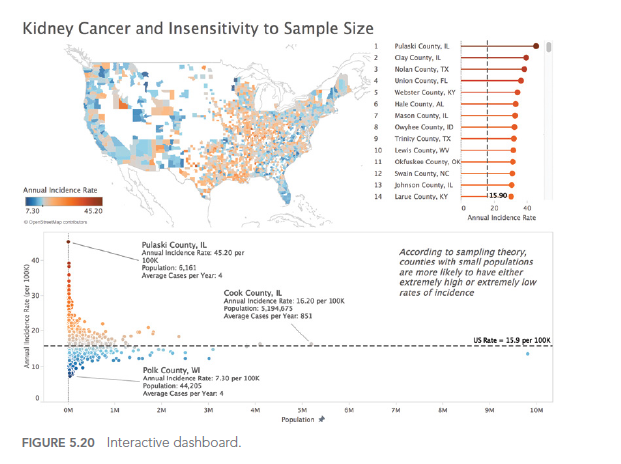

Grâce à l’accès en temps réel aux données, les entreprises peuvent prendre des décisions plus rapidement et de manière plus agile. En utilisant des tableaux de bord et des analyses en temps réel, les décideurs disposent des informations nécessaires pour réagir rapidement aux changements du marché et aux nouvelles opportunités.

La prise de décision éclairée repose sur l’accès à des données précises et actualisées. Les entreprises qui investissent dans des systèmes de collecte, d’analyse et de visualisation des données sont mieux armées pour prendre des décisions rapides et éclairées. En exploitant les données disponibles, elles peuvent évaluer rapidement les tendances du marché, comprendre les besoins des clients et identifier les opportunités de croissance

Rapidité sans compromis sur la qualité

Alors que la rapidité est essentielle dans un environnement commercial concurrentiel, cela ne signifie pas sacrifier la qualité des décisions. Les données fournissent un cadre objectif sur lequel baser les choix, réduisant ainsi les risques d’erreurs coûteuses liées à la prise de décision impulsives ou mal informées. En combinant vitesse et précision, les entreprises peuvent prendre des décisions efficaces tout en maintenant un niveau élevé de qualité et de pertinence

L’importance de la culture de données

Au-delà des outils et des technologies, la prise de décision éclairée repose sur une culture organisationnelle qui valorise les données et favorise la collaboration. Les entreprises qui encouragent une culture de données sont mieux équipées pour collecter, analyser et utiliser efficacement les informations pour prendre des décisions. En encourageant la transparence, la communication et la collaboration, ces entreprises peuvent exploiter pleinement le potentiel des données pour stimuler l’innovation et la croissance